[:pt]Com hábitos de compra e de consumo cada vez mais digitais por parte dos clientes, cresce diariamente a necessidade das empresas estarem alinhadas com essas novas necessidades. Todos os dias, o número de usuários em lojas online aumenta, a quantidade de e-mails registrados para recebimento de promoções e novidades dos e-commerces cresce, e o investimento nessas plataformas e tecnologias deve seguir esse mesmo fluxo.

O CDP chega para resolver dois grandes problemas do mercado omnichannel:

Integração de dados e atribuição de investimentos de mídia, além de entregar diversas outras vantagens. O Customer Data Platform integra os dados dos clientes das lojas físicas, online, web behavior e interações com a marca, permitindo às empresas uma visão única do cliente, porque mesmo comprando em diversos canais ele é a mesma pessoa e assim deve ser percebido. Essa visão unificada se mostra muito importante na hora de mensurar a atribuição dos investimentos feitos em todos os canais, e a partir dessas análises se torna possível entender a melhor alocação dos investimentos em estratégias de marketing.

Coletar e compilar todos esses dados recebidos diariamente dá um trabalho enorme, para isso são utilizadas diversas plataformas, milhares e milhares de linhas e planilhas geradas, a higienização e agrupamento destes dados, para daí sim conseguir “vê-los” com clareza e poder orquestrar as campanhas de comunicação com estes clientes.

Uma parte importante da orquestração dessas campanhas é mensurar os seus resultados, quão efetivas elas foram e de fato quanta receita geraram. E sem um CDP que demonstre a verdadeira atribuição devida à cada campanha ativada, essa mensuração de receita se torna praticamente impossível, pois sabemos que os clientes podem ser impactados por um e-mail marketing e realizar a compra na loja física; experimentar uma peça de roupa no pdv e finalizar a transação pelo aplicativo; comprar pelo site e depois trocar na loja, são diversas as possibilidades.

E como é possível saber se o investimento que a sua empresa faz no digital (disparo de emails, ads, redes sociais, promoções e segmentações) possui o retorno esperado? Como saber se as vendas referentes àquela ação foram realmente atribuídas a ela?

Integrando dados do CRM, web behavior, interação em campanhas, email, e-commerce, loja física, SAC, NPS e muito mais o CDP (Customer Data Platform), consegue enriquecer os dados de cada usuário, permitindo que sua empresa tenha uma visão única e completa de cada cliente.

Sabemos que já não é mais o produto ou o serviço que são o foco da venda, e sim o consumidor. Hoje quanto mais se sabe sobre os gostos e hábitos de um usuário e em quais canais ele navega, maior é a possibilidade de uma comunicação assertiva para aquela pessoa, entregando a mensagem certa, na hora certa, pelo canal certo, para a pessoa certa, aumentando a chance de conversão.

E quais os benefícios disso tudo?

Maior assertividade na comunicação gera aumento na conversão para as campanhas de marketing. Otimizar as ferramentas de captação de dados permite reduzir o tempo que os profissionais gastam nesta atividade. A comunicação certa, na hora certa, pelo canal certo fideliza e engaja o cliente. Sabendo como, quanto e em quais mídias investir ocasiona aumento do ROI no e-commerce e nas lojas físicas.

O CDP foi criado para que todo o foco do trabalho esteja voltado para o consumidor, em atender às suas necessidades e superar suas expectativas.

Curioso para saber mais? Acompanhe nossas redes sociais e se inscreva na nossa newsletter.[:]

Tag: big data

[:pt]Como potencializar o seu CRM otimizando ferramentas de captação de dados[:]

[:pt]Data is everywhere! Os dados estão por toda parte e em todos os pontos de contato de uma marca com seus clientes. A coleta e tratamento dessas informações é uma tarefa árdua, que demanda muito tempo e alinhamento dos times de data services. A boa notícia é que já existem softwares que facilitam e otimizam esse trabalho e podem fazer toda diferença na hora de gerir e utilizar os dados dos seus clientes.

Um estudo feita pela Forbes mostra que as empresas utilizam cerca de 16 diferentes ferramentas para coletar e tratar os dados dos seus clientes, chega a cansar só de pensar o trabalho e retrabalho que isso deve dar. Outro estudo, agora feito pela Harvard Business Review, afirma que cerca de 80% do tempo das equipes responsáveis por essas funções é gasto na coleta e tratamento destes dados.

Se hoje entende-se que dados são o novo petróleo, não podemos permitir que seja gasto tanto tempo e dinheiro (porque tempo é dinheiro) para refiná-los. Assim como uma refinaria desenvolveu tecnologia para extração, coleta e tratamento de petróleo e aprendeu a transformá-lo em gasolina de forma ágil e eficiente, já existem tecnologias para captação, tratamento e integração de dados com agilidade e eficiência, transformando-os em inteligência para as corporações, que geram comunicação, personalização e vendas.

Hoje, a coleta e integração dos dados dos clientes dentro das empresas ainda funciona de forma compartimentada, gerando uma enorme grey area entre as equipes, onde as informações não conversam entre si, não falam o mesmo idioma e acabam não sendo estocada no mesmo lugar, e isso é um grande problema, que gera muito retrabalho e níveis de eficiência muito baixos.

A boa notícia é que, compreendendo essa necessidade latente do mercado, empresas de tecnologia já desenvolveram soluções completas para essa problemática, oferecendo ferramentas que sozinhas são capazes de suprir todas essas demandas. Funcionando como um “centro de comando” por onde passam todos os dados oriundos dos clientes, tratando e compreendendo essas informações de forma padrão, essas plataformas são capazes de gerar inteligência com precisão e agilidade jamais antes vistas.

Parece bom demais pra ser verdade, né? Mas pode acreditar que é.

Quer saber mais a respeito? Fica de olho nas nossas redes sociais, que logo iremos apresentar tudo sobre ela, aguardem.. [:]

[:pt]Big Data: A importância de saber o que é e como usar[:]

[:pt]Que o Big Data é um dos assunto do momento não há dúvidas. É atualmente um dos temas mais abordados em seminários e palestras sobre tendências tecnológicas e de mercado e certemente já deve ter sido comentado na sua empresa. Está em dastaque nas companhias dos mais diversos ramos de atuação e nenhum executivo quer que sua empresa fique para trás nesse novo movimento de mercado que surge, mas alguns profissionais ainda sabem pouco sobre sobre o que Big Data realmente é e o que fazer com ele.

Dan Ariely, professor norte americano, definiu o momento atual do Big Data como sendo algo similar ao sexo para os adolescentes: todos falam sobre o assunto, ninguém sabe ao certo como funciona, todos pensam que os outros estão fazendo e então todos dizem que também estão fazendo. Tirando as brincadeiras de lado, essa definição faz bastante sentido e por isso é necessário entendermos ao certo o que é o Big Data e como as suas aplicações irão afetar nossas vidas, ou melhor, já estão afetando…

Então, o que é o Big Data?

Big Data é definido como qualquer conjunto de dados que somente terão um valor real e uma aplicação prática através da utilização de novas tecnologias para armazenamento e análise devido a sua diversidade, escala, distribuição e velocidade de criação. É uma definição bastante ampla mas que esclarece um pouco mais esse tema. Para melhorar ainda mais a compreensão o autor Bernard Marr definiu os 5Vs associados ao Big Data. São eles: Volume, Velocidade, Variedade, Veracidade e Valor.

O Volume de movimentações online cresce exponencialmente ao longo dos últimos anos. O número de usuários e de transações ocorridas por Facebook, YouTube, LinkedIn, Whastapp, Instragam, Spotify geram um montante inimaginável de informações. Os dados circulam na rede em alta Velocidade e a necessidade de controlar e utilizar essas informações de modo produtivo é um grande desafio para os modelos tradicionais. Cada vez mais é preciso que as ações sejam tomadas em tempo real, de forma imediata, e essa agilidade é algo novo, pois em um passado bastante recente ainda tinha-se tempo para montar analises, planejar ações e tomar decisões.

Além disso a Variedade de dados gerados no universo digital é imensa: fotos, vídeos, textos, acessos a sites, áudios, clickstream, comentários, etc… E como processá-los e fazer com que esses dados, que se misturam em qualitativos e quantitativos, se tornem informações úteis e gerem ações práticas para melhoria do negócio é outro grande desafio. Essa combinação de Volume, Velocidade e Variedade chamam a atenção para a questão da Veracidade. Sabemos que os modelos tracionais de análise de dados possuem volumes limitados de dados, que precisam ser 100% estruturados, e possuem um longo tempo de processo. Por esse motivo, abre-se mão de um pouco da confiança dos dados com o objetivo de aumentar a rapidez de resposta e da tomada de decisão, que é a vantagem competitiva buscada pelas empresas.

Com isso chegamos ao último, e talvez mais importante, ponto: Valor. O que conseguimos gerar de valor concreto para as empresas utilizando Big Data? Como tornar esse montante de dados em conhecimento relevante? Quais informações são realmente importantes? Estima-se que apenas 1% dos dados gerados pelas corporações são utilizados, na prática, em análises para tomada de decisões, ou seja, a oportunidade de avanço nessa área é enorme.

O manejo e aplicação correta dos resultados obtidos através das análises e higienização de Big Data auxiliam companhias a criarem estratégias de marketing e inteligência para seus negócios. Cada vez mais o mercado enxerga o valor ($) real dos dados, e quem souber tirar vantagem dos dados que sua empresa produz vai estar à frente da concorrência.

Texto adaptado de Pedro Soares – RM at the Heineken Company[:]

[:pt]A tanbigilização da informação: como transformar dados[:]

[:pt]Muitas vezes, durante uma análise de Web Analytics, acabamos encontrando dificuldades para tangibilizar um dado. Ou seja, transformar esse dado em algo mais concreto e de fácil entendimento. A melhor forma para lidar com esse problema é cruzar informações de diferentes ferramentas para chegar a uma conclusão.

Para facilitar a explicação usaremos como exemplo o Hotjar, uma ferramenta bastante utilizada para tangibilizar dados e concluir análises. Mas como isso é feito?

Imagine um cenário onde você está analisando uma taxa de saída de 60% em uma página de cadastro, e a média do seu site é de 43%. Com certeza tem algo nessa página fazendo com que o usuário saia do site e não siga o fluxo.

Você pode investigar mais informações nesta página, como o tempo que o usuário leva para sair e se ele visualiza 100% do scroll. Isso vai te ajudar a reunir mais argumentos para poder entender melhor o seu comportamento na página e tornar cada vez mais fácil de compreender os motivos.

Com o Hotjar, por exemplo, você consegue pegar essas informações analisadas e reunir em um vídeo do usuário na página. Certamente, ao analisar esse vídeo você identificará, por exemplo, em qual campo o usuário está saindo do site. E ao cruzar esse dado com a taxa de saída, conseguirá saber exatamente em qual etapa o usuário está deixando o site, onde a experiência está sofrendo atríto.

Imagine que você é uma instituição de ensino online e possui uma página com um formulário, que o usuário necessita preencher por completo para garantir a sua pré-matrícula. Você mediu que essa página está com 60% de saída e a sua média é de 43%, como citamos acima. Ao analisar os vídeos do Hotjar, você identifica que pede para o usuário o título de eleitor e também o certificado de reservista. SÉRIO! Você que está lendo esse artigo sabe de cabeça qual é o seu título de eleitor e seu certificado de reservista? Muito provavelmente não, pois são documentos pouco utilizados. O Hotjar pode te ajudar a tangibilizar que o usuário está abandonando o site nessa parte de preenchimento de documento, pois é algo específico e que as pessoas não possuem de cabeça ou de fácil acesso.

E você, que é a instituição, vale o pensamento: será que realmente precisa dessa informação para garantir a pré-matrícula do usuário? Se não precisar, qual é o motivo de você estar pedindo isso online? Talvez você perceba que era exatamente nesse momento que o usuário está abandonando o site durante o preenchimento. Mas, de qualquer forma, ainda seria apenas um achismo, e não uma certeza.

O que estamos falando aqui é justamente para você tangibilizar esse dado. Mostrar em vídeo que o usuário está indo embora do seu site ao clicar naquele campo, o qual não está preenchendo.

Outra forma de você tangibilizar essa informação seria fazendo uma pesquisa com o usuário após ele fazer uma compra, ou até mesmo quando ele estiver saindo do seu site.

Fonte: E-commerce Brasil[:]

[:pt]Como o spotify usa dados pra gerar hits de conteúdo[:en]Spotify’s CMO on Using Data to Create Content Marketing Hits[:es]Como el spotify utiliza datos para generar hits de contenido[:]

[:pt]Utilizar os dados para entender seus consumidores é uma arte. Muitas marcas já entenderam que os dados são o caminho para o relacionamento, mas poucas fazem tão bem o que se propõem quanto o Spotify.

Na #ThinkContent Summit 2017 da NewsCred, Seth Farbman, Diretor de Marketing do Spotify, compartilhou como o serviço de streaming de música é capaz de entender clientes em um nível individual, bem como identificar tendências culturais maiores, explorando profundamente seus dados.

Aqui estão os principais destaques de sua palestra – ou o que chamamos de sua playlist de “Como arrasar com dados no marketing de conteúdo”.

Track 1: Veja pessoas, não fontes de dados

Alguns anos atrás, Big Data era a palavra-chave que fazia os profissionais do marketing pensarem sobre infinitas possibilidades, mas Farbman diz que era muito mais um truque de mágica: “De repente, poderíamos saber tudo o que é valioso sobre nosso consumidor e acompanhar o impacto da nossa mensagem no funil de vendas, até o lifecycle value. Mas era algo muito vago”.

O que realmente aconteceu é que o Big Data deu aos profissionais de marketing o que Farbman chama de “a parte mais banal e irritante do marketing”: o retargeting. “Então, se você explorar a web e comprar sapatos on-line, podemos insistir em fazer você comprar mais desses sapatos. Os dados estavam te reduzindo a um minuto da sua vida – o momento em que você comprou um par de sapatos “, explica.

Mas, é claro, seus clientes são mais que uma decisão de compra.

Eles são seres humanos emocionais e únicos, cujos sentimentos podem mudar de um momento para o outro. É por isso que as marcas precisam olhar para os dados com mais seriedade e começar a gerar insights que dialogam com os clientes como pessoas, criando conexões duradouras que realmente melhoram os resultados nos próximos anos, de acordo com Farbman.

Track 2: Entenda as pessoas no seu contexto cultural

“Se você está simplesmente acumulando dados, ficará rapidamente sobrecarregado”, afirma Farbman.

Com a quantidade de informação que o Spotify recolhe, ele deve saber do que está falando. Basta pensar nos usuários ativos (mais de 100 milhões) e nas listas de reprodução (mais de 2 bilhões), para começo de conversa. Para ele, as marcas devem começar com uma única premissa e, em seguida, procurar tendências e padrões culturais em seus dados.

“Temos dados sobre como as pessoas estão usando música em suas vidas. É altamente emocional. Podemos dizer quando alguém terminou um namoro. As pessoas criaram playlists para enviar ao seu futuro ex. Nós sabemos quando as pessoas estão correndo, estudando, tentando ir dormir “, complementa Farbman.

Além dos padrões comportamentais, seu público também pode estar falando sobre si diretamente. “Você precisa estar atento, escutando-os”. E completa: “quando alguém cria uma lista de reprodução intitulada “Odeio o Bob”, sabemos o que está acontecendo ali. Para nós, os dados oferecem essa visão incrível do que está acontecendo no coração de alguém “.

Como uma empresa de música, essas informações ajudam o Spotify a recomendar mais músicas. Mais do que isso, permite que o Spotify entre na cabeça do cliente e use isso como inspiração criativa. Aqui está um exemplo: depois de todo debate presidencial no ano passado, a empresa percebeu que cada vez mais listas de reprodução estavam sendo criadas com o título “de mudança”. “Claramente, havia esse sentimento de que as pessoas realmente queriam se mudar para o Canadá. Nós vimos isso no cliente, mas também como um fenômeno cultural “.

O Spotify decidiu criar um anúncio chamado “Moving” que apresentou um casal literalmente dirigindo sua casa para o Canadá com a música”My House” do Flo Rida tocando em segundo plano. A ideia era mostrar aos consumidores que o Spotify realmente entende o que eles estão sentindo.

Track 3: Leve para o lado pessoal

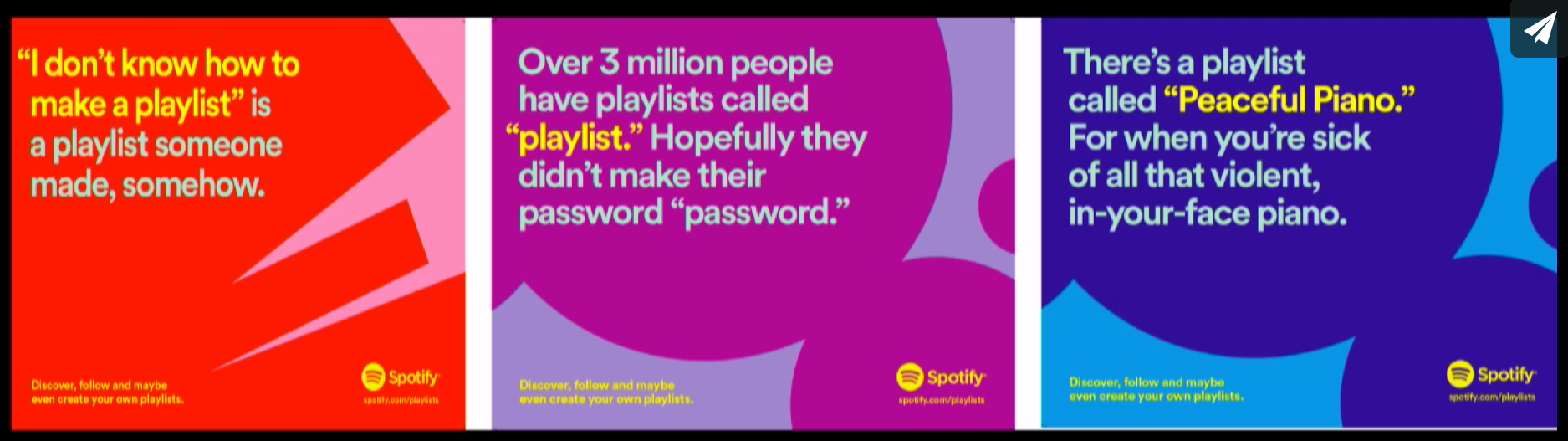

Tal como acontece com o exemplo acima, os dados podem refletir algo grande e cultural, mas também podem ser levados ao nível individual. É por isso que a equipe criativa do Spotify passa tempo criando anúncios e outros conteúdos extremamente direcionados a nichos de clientes menores ou a bairros em particular.

Outro exemplo de Spotify se divertindo com seus dados é quando eles perceberam que às vezes as pessoas dão suas listas de reprodução nomes engraçados e estranhos. “Nós chegamos aos indivíduos e dizemos: ‘curtimos sua playlist, olha aqui a piada’, e pergunte se eles estão dispostos a participar. Nunca tivemos uma recusa”, diz Farbman.

Talvez a personalização de conteúdo mais bem sucedida que o Spotify já fez, no entanto, seja o Year in Music. “Nós tivemos essa idéia para retornar às pessoas seu histórico de música. 130 milhões de pessoas receberam um e-mail individualizado para um link individualizado para uma experiência individualizada que mostra o que eles ouviram ao longo do ano e quais artistas ajudaram a promover para que possam se gabar disso”, salienta.

Pense em como você pode personalizar a experiência do seu cliente, seja convidando seus fãs a compartilhar seu próprio conteúdo ou a dar-lhes algo de valor que é apenas para eles.

Track 4: Ouse

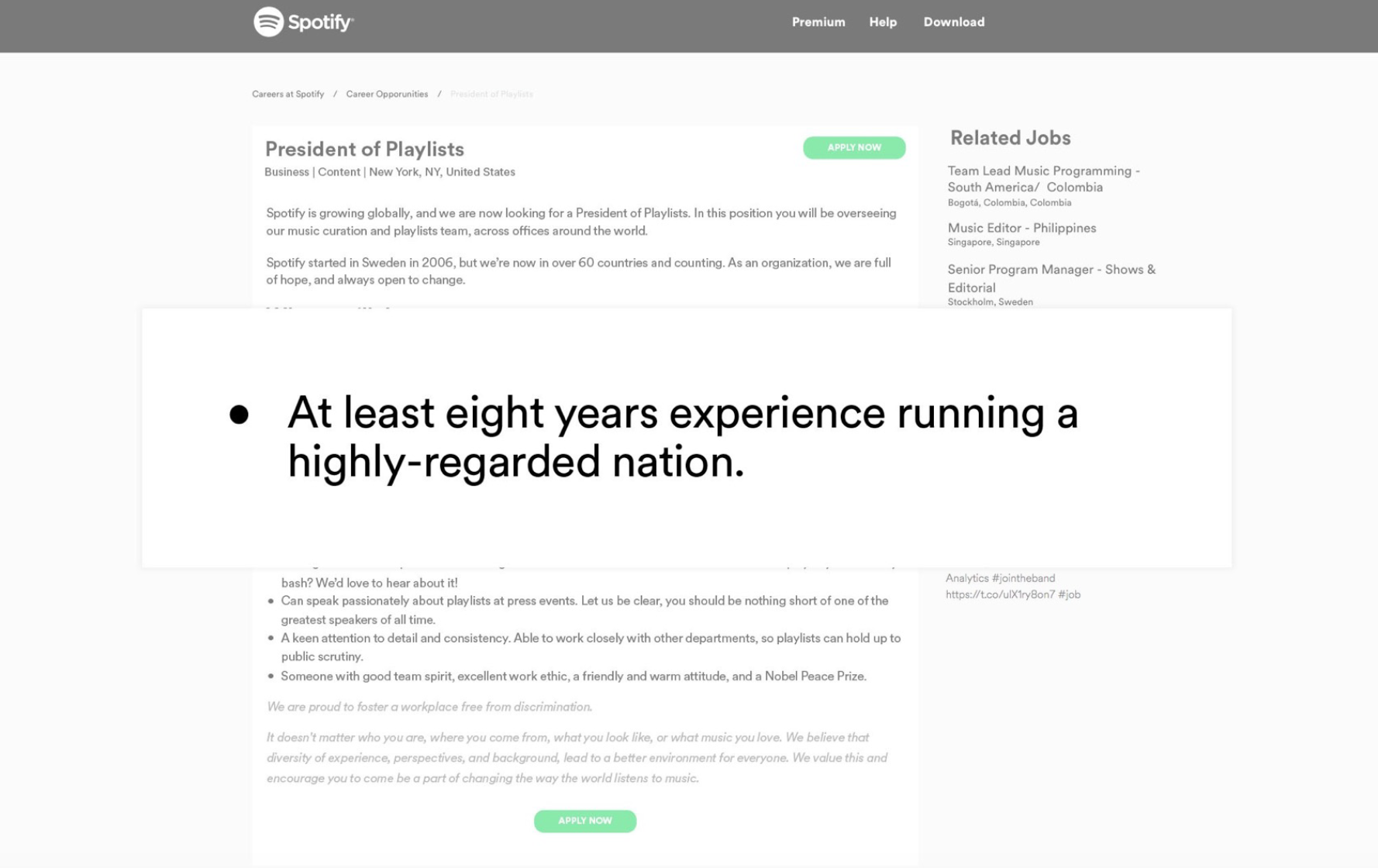

“Não deixe passar a oportunidade de experimentar fora da sua zona de conforto criativo”, aconselha Farbman. É por isso que, quando Barack Obama fez um rápido comentário ao ex-embaixador da Suécia sobre querer um emprego no Spotify quando o seu mandato terminou, eles aproveitaram a chance.

A equipe do Spotify surgiu com a idéia de criar uma vaga de emprego na sua página de carreiras chamada “Presidente das playlists” e tweetar pela conta de Daniel Ek, o fundador da Spotify. Foi um conteúdo divertido que capturou a voz brincalhona da marca. E, para a surpresa de todos, 850 pessoas realmente se candidataram à vaga.

Track 5: Deixe os dados dispararem sua mensagem

Além dos jobs virais e anúncios engraçados, os dados são realmente capazes de melhorar o relacionamento e a retenção.

“Nós recebemos sinais de problemas de retenção o tempo todo. Sabemos dizer quando alguém está usando o Spotify menos, compartilhando menos, criando menos playlists. Mas se posso fazer você criar uma lista de reprodução, sabemos que as chances de seu lifetime value subir e o churn cair são cerca de cinco vezes maiores do que se você não o fizesse. Então, a mensagem de conteúdo deve ser: “Deixa eu te mostrar como criar uma playlist”, diz Farbman.

Como fã, você tira mais prazer do produto, e esse maior prazer afetará as taxas de retenção. Da mesma forma, se alguém na versão gratuita está tentando fazer as coisas apenas disponíveis na versão premium paga, eles receberão uma mensagem informando que, com uma assinatura premium, há menos restrições. Algo tipo: “Vemos que você já tentou pular músicas 15 vezes …”

Em última análise, Farbman explica que, à medida que os profissionais de marketing melhorarem o aproveitamento de dados, poderão criar sistemas que escolhem automaticamente o conteúdo certo para entregar à pessoa certa no momento certo.

Até lá, continue ouvindo o que seus dados estão falando sobre seus clientes para continuar produzindo conteúdo relevante que engaje o seu público. Veja como data analytics pode aumentar o valor do seu negócio. E let’s rock!

Artigo original NewsCred[:en]There is a fine art to leveraging data to understand your consumers, and few brands are doing it as well as Spotify.

At NewsCred’s #ThinkContent Summit 2017, Seth Farbman, Chief Marketing Officer of Spotify, shared how the music streaming service is able to understand individual customers on a personal level, as well as pinpoint larger cultural trends by digging deep into its data.

Here are the key highlights of his talk – or, what we like to call his ultimate “How to Rock Content Marketing Data” playlist.

Track 1: Think People, Not Data Points

A few years ago, “big data” was the buzzword that had marketers thinking about infinite possibilities, but Farbman says it was a lot of smoke and mirrors: “Suddenly, we could know everything that’s valuable to know about our consumer, and follow our messaging and its impact on the sales funnel, all the way down to lifetime value. But it was mostly bull.”

What actually happened is that big data gave marketers what Farbman calls the banalest, disruptive and annoying part of marketing: retargeting.

“So if you explore the web and buy shoes online, we marketers can try to get you to buy more of those shoes incessantly. The data was reducing you down to your smallest moment – the moment you bought a pair of shoes,” he says.

But, of course, your customers are more than one purchasing decision.

They are emotional, unique human beings whose moods may shift moment to moment. That’s why today’s successful brands must look at data with a much keener eye, and begin to draw insights that speak to customers as humans and build lasting connections that actually improve business outcomes for years to come, according to Farbman.

Track 2: Understand People in Cultural Context

“If you are simply in taking massive data, you’ll quickly become overwhelmed,” says Farbman. With the amount of information Spotify collects, he should know. Just think of the active users (more than 100 million) and playlists (more than 2 billion), alone.

Instead, brands must start with a premise, then look for cultural trends and patterns in their data, Farbman says.

“We have data on how people are using music in their lives. It’s highly emotional. We can tell when someone has broken up with someone. People have created playlists to send to their soon-to-be former significant other. We know when people are running, studying, trying to go to sleep,” he says.

Besides noticing repeatable patterns, your audience might also be telling you about themselves directly.

“You have to be listening,” says Farbman.

“When someone creates a playlist titled ‘I hate Bob,’ we’re pretty sure we know what’s going on there. For us, data is this incredible insight to know what’s happening deep inside someone,” he says.

As a music company, such information helps Spotify recommend more songs. But more importantly, it allows Spotify to peek inside the customer’s head, and use that as creative inspiration.

Here’s an example: After every presidential debate last year, Spotify realized that more and more playlists were being created that had the title “moving” in them.

“Clearly there was this feeling that people really wanted to move to Canada. We saw this inside the client but also as a cultural phenomenon,” says Farbman.

Spotify decided to create an advertisement called “Moving” that featured a couple literally driving their house to Canada with the Flo Rida song, “My House” playing in the background. The idea was to show consumers that Spotify really gets what they’re feeling.

Track 3: Get Personal

As with the above example, data can reflect something big and cultural, but it can also be drilled down to the individual level as well. That’s why Spotify’s creative team spends time creating ads and other content that is extremely targeted to smaller customer niches, or particular neighborhoods.

Another example of Spotify having fun with its data is when they realized that sometimes people give their playlists funny and odd names.

“We reach out to individuals and say, ‘We like your playlist, here’s the joke,’ and ask if they’re willing to participate. We’ve never had anyone say no,” says Farbman.

Perhaps the most successful content personalization Spotify does, however, is its Year in Music.

“We had this idea to return to people their music history. For 130 million people, each got an individualized email to an individualized link to an individualized experience that shows what they listened to throughout the year, and what artists they helped break. It allows them to brag about it and share it,” says Farbman.

Think about how you can personalize your customer experience, whether it’s by inviting your fans to share their own content, or giving them something of value that is just for them.

Track 4: Go Bold

Don’t pass up an opportunity to experiment outside of your creative comfort zone, says Farbman.

That’s why when Barack Obama made a quick comment to the former ambassador to Sweden about wanting a job with Spotify as his term was ending, they jumped on it.

The Spotify team came up with the idea to create a job positing on the Spotify career page called “President of Playlists,” and have Daniel Ek, Spotify’s founder, tweet it out.

It was a fun piece of content that captured the playfulness of the brand’s voice.

And, surprisingly, 850 people actually applied for the job.

Track 5: Let Data Trigger Your Message

Beyond viral job postings and funny ads, data is really about improving customer service and retention.

“We get signals of early retention issues all the time. We can tell when someone is using Spotify less, sharing it less, building fewer playlists. But on the flipside, if I can get you to make a playlist, we know that the chances of your lifetime value going up and churn going down are about five times more than if you didn’t. So the content message should be, ‘Let me show you how to make a playlist,’” says Farbman.

As a fan, you get more enjoyment out of the product, and that greater enjoyment will affect retention rates.

Similarly, if someone on the free, ad-supported version of Spotify is trying to do things only available on the premium paid version, they will get a message letting them know that with a premium subscription, there are less restrictions. Something like: “We see you’re trying to skip songs 15 times…”

Ultimately, Farbman says, as marketers get better at harnessing data, systems – not humans – can be created that automatically pick and choose the right content to deliver to the right person at the right time.

But until then, keep listening to what your data is telling you about your customers so you can keep producing the content hits they’ll truly enjoy.

Original article NewsCred[:es]Aprovechar los datos para entender a sus consumidores es un arte y pocas marcas lo están haciendo tan bien como Spotify.

En la #ThinkContent 2017 de NewsCred, Seth Farbman, Director Ejecutivo de Marketing de Spotify, compartió cómo el servicio de streaming de música es capaz de entender a los clientes individuales a nivel personal, así como identificar tendencias culturales más grandes cavando profundamente en sus datos.

Aquí están los aspectos más destacados de su charla, o lo que llamamos su lista de reproducción final de “How to Rock Content Marketing Data”.

Track 1: Piensa en personas, no en fuentes de datos

Hace unos años, “big data” era la palabra de moda que tenía los marketers pensando en posibilidades infinitas, pero Farbman dice que mucho era ilusión: “De repente, podríamos saber todo lo que es valioso para saber acerca de nuestro consumidor y seguir nuestra mensaje y su impacto en el embudo de ventas todo el camino hasta el lifecycle value. Pero eso era en su mayoría solo chamuyo.

Lo que realmente pasó es que los grandes datos dieron a los profesionales lo que Farbman llama la parte más banal, perjudicial y molesta del marketing: retargeting.

“Así que si usted explora la web y compra zapatos online, los vendedores pueden intentar conseguir que usted compre más de esos zapatos incesantemente. Los datos te estaban reduciendo a tu menor momento – el momento en que compraste un par de zapatos “, dice.

Pero, por supuesto, sus clientes son más de una decisión de compra.

Son seres humanos emocionales y únicos cuyos estados de ánimo pueden cambiar a todo momento. Es por eso que las marcas exitosas de hoy deben mirar los datos con mucho más seriedad y empezar a trazar ideas que hablan a los clientes como seres humanos para construir conexiones duraderas que realmente mejoren los resultados del negocio en los próximos años, de acuerdo con Farbman.

Track 2: Entender a la gente en el contexto cultural

“Si simplemente está tomando datos masivos, rápidamente se verá abrumado”, dice Farbman. Con la cantidad de información que Spotify recoge, él debe saber. Basta pensar en los usuarios activos (más de 100 millones) y listas de reproducción (más de 2 mil millones), solo.

En lugar, las marcas deben comenzar con una premisa, después buscan las tendencias y los patrones culturales en sus datos, Farbman dice.

“Tenemos datos sobre cómo la gente está utilizando la música en sus vidas. Es muy emotivo. Podemos decir cuando alguien ha roto con alguien. La gente ha creado listas de reproducción para enviar a su pronto-a-ser ex-otro significativo. Sabemos cuando la gente está corriendo, estudiando, tratando de ir a dormir “, dice.

Además de observar los patrones repetibles, su audiencia también podría estar diciéndole sobre sí mismos directamente.

“Tienes que estar escuchando”, dice Farbman.

“Cuando alguien crea una lista de reproducción titulada ‘Odio a Bob’, estamos bastante seguros de que sabemos lo que está pasando allí. Para nosotros, los datos son esta increíble visión para saber lo que está sucediendo profundamente dentro de alguien “, dice.

Como compañía de música, esta información ayuda a Spotify a recomendar más canciones. Pero lo que es más importante, permite a Spotify mirar dentro de la cabeza del cliente y usarlo como inspiración creativa.

He aquí un ejemplo: después de cada debate presidencial del año pasado, Spotify se dio cuenta de que se estaban creando más y más listas de reproducción que tenían el título de “movimiento” en ellas.

“Claramente había esa sensación de que la gente realmente quería mudarse a Canadá. Vimos esto dentro del cliente pero también como un fenómeno cultural “, dice Farbman.

Spotify decidió crear un anuncio llamado “Moving” que presentaba una pareja literalmente conduciendo su casa a Canadá con la canción de Flo Rida, “My House” jugando en el fondo. La idea era mostrar a los consumidores que Spotify realmente obtiene lo que están sintiendo.

Track 3: Personal

Al igual que con el ejemplo anterior, los datos pueden reflejar algo grande y cultural, pero también se puede perforar hasta el nivel individual también. Es por eso que el equipo creativo de Spotify dedica tiempo a crear anuncios y otro contenido que está dirigido a nichos de clientes más pequeños o vecindarios particulares.

Otro ejemplo de Spotify que se divierten con sus datos es cuando se dieron cuenta de que a veces las personas dan a sus listas de reproducción nombres divertidos y raros.

“Nos acercamos a los individuos y decimos, ‘Nos gusta su lista de reproducción, aquí está la broma’, y preguntar si están dispuestos a participar. Nunca hemos dicho que alguien diga que no “, dice Farbman.

Tal vez la personalización de contenido más exitosa Spotify, sin embargo, sea su Year in Music.

“Tuvimos la idea de devolver a la gente su histórico musical. Para 130 millones de personas, cada uno recibió un correo electrónico individualizado a un enlace individualizado a una experiencia individualizada que muestra lo que escucharon durante todo el año, y qué artistas ayudaron a promover”, dice Farbman.

Piense en cómo usted puede personalizar la experiencia de su cliente, ya sea invitando a sus fans a compartir su propio contenido o dándoles algo de valor que sea solo para ellos.

Track 4: Sea audaz

No deje pasar la oportunidad de experimentar fuera de su zona de confort creativo, dice Farbman.

Es por eso que cuando Barack Obama hizo un comentario rápido al ex embajador de Suecia sobre el deseo de un trabajo con Spotify como su término estaba terminando, ellos lo aprovecharon.

El equipo de Spotify tuvo la idea de crear un puesto de trabajo en la página de la carrera de Spotify llamada “Presidente de Listas de reproducción”, y que Daniel Ek, el fundador de Spotify, lo tweetara.

Fue una pieza divertida de contenido que capturó el juguetón de la voz de la marca.

Y, sorprendentemente, 850 personas realmente solicitaron el trabajo.

Track 5: Deje que los datos activen su mensaje

Más allá de los anuncios de trabajo viral y los anuncios graciosos, los datos realmente tratan de mejorar el servicio al cliente y la retención.

“Tenemos señales de problemas de retención temprana todo el tiempo. Podemos decir cuando alguien está usando Spotify menos, compartiéndolo menos, construyendo menos listas de reproducción. Pero en el otro lado, si puedo conseguir que hagas una lista de reproducción, sabemos que las probabilidades de que tu valor de por vida suba y la rotación de descenso sea cinco veces más que si no lo hicieras. Por lo tanto, el mensaje de contenido debe ser: “Permítanme mostrarle cómo crear una lista de reproducción”, dice Farbman.

Como fan, obtendrá más disfrute del producto, y ese mayor disfrute afectará las tasas de retención.

Del mismo modo, si alguien en la versión gratuita de Spotify está tratando de hacer cosas que sólo están disponibles en la versión de pago premium, obtendrá un mensaje que les permite saber que con una suscripción premium, hay menos restricciones. Algo así como: “Vemos que estás tratando de saltar canciones 15 veces …”

En última instancia, dice Farbman, a medida que los vendedores mejoran en el aprovechamiento de los datos, se pueden crear sistemas que seleccionan automáticamente el contenido adecuado para entregarlo a la persona adecuada en el momento adecuado.

Pero hasta entonces, siga escuchando lo que sus datos le están diciendo acerca de sus clientes para que pueda seguir produciendo los hits de contenido que realmente disfrutarán.

Texto original NewsCred[:]

[:pt]Data analytics: aumente o valor do seu negócio[:en]Data analytics: Increase your business value [:es]Análisis de datos: Aumente el valor de su negocio[:]

[:pt]Data analytics – ou análise de dados – vai muito além das plataformas de Business Intelligence. Elas são apenas a ferramenta. A evolução da jornada de implantação de business analytics (BA) para resolver problemas de negócios deve culminar numa estratégia que gere valor para a empresa. Para o Gartner, dados são a chave para a transformação do negócio digital.

Na Conferência Gartner Data & Analytics nesta semana (20/06/17), em São Paulo, Donald Feinberg, vice-presidente e analista emérito do Gartner, afirmou que na maioria das vezes parece haver uma abundância de dados sobre a qual os líderes não compreendem seu valor.

Ele acredita que os líderes de negócios deveriam se concentrar na construção de uma organização centrada em dados, aproveitar as principais tendências e as tecnologias emergentes, além de desenhar os resultados que lideram os modelos de negócios transformacionais.

3 takeaways do Gartner sobre Data Analytics

1. A importância da liderança

As empresas precisam considerar a criação de uma liderança em dados, a começar com a nomeação de um “pai” para o projeto, um Chief Data Officer (CDO). Pesquisa da Gartner sobre os principais agentes de dados mostra que as principais responsabilidades do CDO são:

// Supervisionar iniciativas de análise e governança de dados,

// Se responsabilizar pela definição das estratégias de análise,

// Organizar e garantir a confiabilidade e o valor da informação, ou seja, sua governança.

2. Tecnologia e robustez

Após a liderança, o próximo passo é lidar com a escala e a variedade dos dados disponíveis. As abordagens tradicionais de infraestrutura de gerenciamento de dados, como armazéns, fluxos de dados em lote e bancos relacionais começam a quebrar em face dos requisitos de negócios digitais. As organizações devem adotar rapidamente arquiteturas e tecnologias, como a virtualização de dados.

“Até 2018, o Gartner prevê que as organizações com recursos de virtualização de dados gastarão 40% menos na construção e gerenciamento de processos de integração de dados para conectar ativos de informação”, diz Feinberg.

3. Dados e seu valor para o negócio

Uma das chaves para maximizar a contribuição das empresas e aproveitar esta abundância de poder de computação e expertise analítica é transformar a governança de dados em um facilitador de negócios. A gestão de dados precisa ser colaborativa, ágil, flexível e orientada para negócios.

“Obter este direito – políticas orientadas por contexto e autoridade e responsabilidade distribuídas – é fundamental para fornecer a base confiável e de alto valor de dados que suporte qualquer caso de uso que a liderança de uma organização possa ter em mente”, finaliza.

Conclusão

Juntos, dados e análises são os catalisadores mais poderosos para a mudança na empresa.

Fontes:

TI inside

Gartner Data & Analytics Summit[:en]Data analytics – or data analysis – goes far beyond Business Intelligence platforms. They are just the tool. The evolution of the business analytics (BA) deployment journey to solve business problems should culminate in a strategy that creates value for the company. For Gartner, data is the key to the transformation of the digital business.

At the Gartner Data & Analytics Conference this week (06/20/17) in São Paulo, Donald Feinberg, vice president and emeritus analyst at Gartner, said that most of the time there seems to be plenty of data about which leaders do not Understand its value.

He believes that business leaders should focus on building a data-centric organization, harnessing key trends and emerging technologies, and designing the results that drive transformational business models.

3 Gartner takeaways on Data Analytics

1. The Importance of Leadership

Companies need to consider creating data leadership, starting with appointing a “father” to the project, a Chief Data Officer (CDO). Gartner’s survey of key data agents shows that the primary responsibilities of CDO are:

// Supervise data analysis and governance initiatives,

// Be responsible for the definition of analysis strategies,

// Organize and guarantee the reliability and value of information, that is, its governance.

2. Technology and robustness

Following the lead, the next step is to deal with the scale and variety of the data available. Traditional data management infrastructure approaches such as warehouses, batch data flows, and relational databases begin to break in the face of digital business requirements. Organizations must quickly adopt architectures and technologies, such as data virtualization.

“By 2018, Gartner predicts that organizations with data virtualization capabilities will spend 40 percent less on building and managing data integration processes to connect information assets,” says Feinberg.

3. Data and its value to the business

One of the keys to maximizing business input and leveraging this abundance of computing power and analytical expertise is to transform data governance into a business enabler. Data management needs to be collaborative, agile, flexible and business-oriented.

“Getting this right – context-oriented policies and distributed authority and accountability – is critical to providing the reliable, high-value database that supports any use case that an organization’s leadership can keep in mind,” he says.

Conclusion

Together, data and analysis are the most powerful catalysts for change in the enterprise.

Sources:

TI inside

Gartner Data & Analytics Summit[:es]Análisis de datos – o análisis de datos – va mucho más allá de las plataformas de Business Intelligence. Son sólo la herramienta. La evolución del viaje de despliegue de analítica empresarial (BA) para resolver problemas empresariales debe culminar en una estrategia que crea valor para la empresa. Para Gartner, los datos son la clave para la transformación del negocio digital.

Donald Feinberg, vicepresidente y analista emérito de Gartner, dijo en la conferencia Gartner Data & Analytics esta semana (06/20/17) en Sao Paulo, que la mayoría de las veces parece que hay muchos datos sobre qué líderes no entienden es valioso.

Él cree que los líderes empresariales deben centrarse en la construcción de una organización centrada en los datos, aprovechando las tendencias clave y las tecnologías emergentes, y diseñando los resultados que impulsan los modelos empresariales transformacionales.

3 ofertas de Gartner en Data Analytics

1. La Importancia del Liderazgo

Las empresas deben considerar la creación de liderazgo en los datos, comenzando por designar un “padre” para el proyecto, un Director de Datos (CDO). La encuesta de Gartner sobre los principales agentes de datos muestra que las principales responsabilidades de CDO son:

// Supervisar el análisis de datos y las iniciativas de gobernanza,

// Ser responsable de la definición de estrategias de análisis,

// Organizar y garantizar la fiabilidad y el valor de la información, es decir, su gobierno.

2. Tecnología y robustez

Siguiendo el ejemplo, el siguiente paso es tratar la escala y variedad de los datos disponibles. Los enfoques tradicionales de la infraestructura de gestión de datos, como los almacenes, los flujos de datos por lotes y las bases de datos relacionales, comienzan a romperse frente a las necesidades de los negocios digitales. Las organizaciones deben adoptar rápidamente arquitecturas y tecnologías, como la virtualización de datos.

“Para 2018, Gartner predice que las organizaciones con capacidades de virtualización de datos gastarán un 40 por ciento menos en la construcción y gestión de procesos de integración de datos para conectar los activos de información”, dice Feinberg.

3. Datos y su valor para el negocio

Una de las claves para maximizar el aporte empresarial y aprovechar esta abundancia de poder computacional y experiencia analítica es transformar el gobierno de datos en un facilitador de negocios. La gestión de datos debe ser colaborativa, ágil, flexible y orientada a los negocios.

“Conseguir este derecho – las políticas orientadas al contexto y la autoridad distribuida y la rendición de cuentas – es fundamental para proporcionar la base de datos confiable, de alto valor que soporta cualquier caso de uso que el liderazgo de una organización puede tener en mente”, dice.

Conclusión

Juntos, los datos y análisis son los catalizadores más poderosos para el cambio en la empresa.

Fuentes:

TI inside

Gartner Data & Analytics Summit[:]

[:pt]Como os dados podem superar a comoditização em viagens[:en]How data can overcome the travel commoditization[:es]Como los datos pueden superar la comoditización en los viajes [:]

[:pt]Em muitos casos, o setor de viagens se tornou uma commodity, semelhante ao açúcar,a o petróleo ou ao aço, onde o produto é indistinguível dos concorrentes e a principal maneira de diferenciar as ofertas está no preço. Na verdade, é justo dizer que hoje há pouca diferença entre voos de baixo custo ou entre um hotel de negócios de preço médio, por exemplo.

O dilema dos preços foi o tema central no recente evento da marca EyeforTravel nos Estados Unidos, onde houve um claro reconhecimento de que essa abordagem nunca será suficiente e a única maneira de se destacar é através da inovação digital e dos dados.

O desafio

Claramente há um desafio para as empresas de turismo que dependem de diferenciar seu produto para manter a competitividade. Assim, a grande questão é: como os fornecedores podem criar uma diferenciação significativa nos seus produtos para fidelizar os clientes e, ao mesmo tempo, manter-se competitivos no preço? A resposta a esse desafio reside no uso efetivo e em uma grande análise de dados.

“A única maneira de superar a comoditização no mercado de viagens é através da personalização e do uso mais inteligente dos dados. As marcas precisam entender quem são seus clientes, para onde estão viajando, quando e por quê. Com esses dados elas podem descobrir o que precisam fazer para se destacarem da concorrência”. (Carlos Sánchez, gerente sênior de análise de dados e inovação de produtos da agência de viagens de negócios Carlson Wagonlit Travel)

A solução

Uma maneira de fazer um produto padronizado parecer diferente é envolvê-lo em uma experiência que possa distingui-lo. Por exemplo, enquanto cada bilhete é essencialmente o mesmo se você estiver olhando apenas a parte aérea básica, ele pode ser diferenciado se as companhias aéreas puderem melhorar a experiência da viagem de ponta a ponta, adicionando serviços auxiliares. Esses serviços podem incluir melhor funcionalidade de aplicativos, oferecendo uma reserva mais simples, check-in rápido e fácil acesso a serviços adicionais como viagens ao aeroporto e outros.

Da mesma forma, hotéis comoditizados podem melhorar sua experiência com benefícios extras como check-in antecipado, chaves de quarto baseadas em app, serviços de concierge digital, reconhecimento do hóspede, tarifas individualizadas etc.

Dessa maneira, enquanto o produto básico é indiferenciado o cliente percebe a experiência geral como memorável positivamente. “Tudo é voltado para transformar a viagem na melhor experiência que pode ser, uma experiência que permanece em sua mente para que você peça o mesmo fornecedor na próxima vez que viajar“, diz Sánchez.

O que torna isso muito mais fácil hoje é o crescente uso de dispositivos móveis pelos viajantes, a disponibilidade de enormes quantidades de dados na base de clientes e algoritmos de inteligência artificial precisos, que ajudam a identificar maneiras de tornar as viagens de negócios mais fáceis e marcantes.

E na prática?

Por exemplo, a Pmweb dispõe de uma estrutura completa de serviços e tecnologias de dados orientados ao setor de hotelaria. Diariamente, pelas integrações com os principais PMS do mercado, recebemos imensas quantidades de dados de hóspedes, além de realizarmos a coleta e o tratamento de dados que vêm de web behavior, no sites dos clientes.

Esses dados, integrados ao Pmweb CRM, podem ser usados em campanhas online de pré-check-in, pós-check-out, reserva abandonada, avaliação da hospedagem, cross-sell e outras. Além disso, eles podem apoiar a estratégia de precificação individual das tarifas por meio do Let’s Book, o motor de reservas que usa esses dados, considerando fatores como frequência de hospedagem, ticket médio, perfil geográfico e demográfico, interações com os e-mails e outras.

No entanto, quaisquer que sejam as ferramentas escolhidas, as plataformas de inteligência de negócios podem ser baseadas em quatro características essenciais:

• Modelo de dados centrado no usuário e baseado em eventos

• Plataforma cruzada – cobrindo o aplicativo nativo, o site para celular e o website

• Coleta de dados em tempo real, manipulação e exportação de dados brutos a qualquer escala

• Dados acessíveis por meio de ferramentas simples e fáceis de usar, que permitem que as pessoas obtenham respostas a perguntas.

Fonte: eye for travel[:en]In many cases, the tourism industry has become a commodity, similar to sugar, oil or steel, where the product is not distinguished from competitors and the main way of differentiating supply is price. In fact, it is fair to say that today there is little difference between low-cost flights or between business hotels, for example.

The price dilemma was the main theme in the recent EyeforTravel event in the United States, where there was a clear recognition that this approach is not easy and the only way to highlight is through digital innovation and data.

The challenge

Clearly there is a challenge for tourism companies that depend on differentiating their product to remain competitive. So the big question is: how can suppliers create a significant difference in their products to keep customers loyal and at the same time remain competitive in price? The answer to this challenge lies in the effective use and intensive analysis of the data.

“The only way to overcome commoditization in the travel market is through personalization and smarter use of data. Brands need to understand who their customers are, where they are traveling to, when and why. With this data they can discover what to do to stand out from the competition. ” (Carlos Sánchez, senior manager of data analysis and innovative products of business travel agency Carlson Wagonlit Travel)

The solution

One way to make a standardized product look different is by wrapping it in an experience that sets it apart. For example, while each ticket is essentially the same if you are looking only for the basic aerial part, the difference can be in the improved airline end-to-end travel experience with the addition of extra services. These services can include better application functionality, offering simpler bookings, quicker check-in and easy access to additional services, stories such as airport trips and others.

Likewise, commoditized hotels can improve their experience with additional benefits, such as check-in in advance, room-key application, digital concierge services, customer recognition, individual rates, etc.

Thus, while the commodity itself is undifferentiated, the customer perceives the overall experience as positively memorable. “Everything is geared towards making the trip the best experience it can be, an experience that stays in your mind and makes you choose the same company the next time you travel,” says Sanchez.

What makes it much easier today is the increased use of mobile devices by travelers, the availability of large amounts of data in the customer base, and precise artificial intelligence algorithms that help identify ways to make business travel easier and more memorable.

And in practice?

For example, Pmweb offers a complete infrastructure of data services and technologies oriented to the hospitality industry. Every day, through integrations with the major PMSs in the market, receiving large amounts of data from the guests, performing the collection and processing of the data from customers’ web behavior on the client’s website.

This data, integrated with Pmweb CRM, can be used in online campaigns for pre-check in, post-check out, abandoned reservations, reviews, cross-selling and others. In addition, the data can follow the strategy of individual fare prices on Let’s Book, the booking enginethat uses this data, taking into account factors such as frequency, average tickets, geographic and demographic profile, email interaction and others.

However, whatever tools are chosen, business intelligence platforms can be based on four key features:

- User-centered, event-based data model

- Cross platform – covering native application, mobile site and website

- Real-time data collection, manipulation and export of raw data at any scale

- Data accessible through simple, easy-to-use tools that allow people to get answers to questions.

Source: eye for travel[:es]En muchos casos, la industria del turismo se ha convertido en una mercancía, similar al azúcar, aceite o acero, donde el producto no se distingue de los competidores y la principal forma de diferenciar la oferta es en el precio. De hecho, es justo decir que hoy en día hay muy poca diferencia entre vuelos de bajo costo o entre hoteles de negocios, por ejemplo.

El dilema de los precios fue el tema principal en el reciente caso de la marca EyeforTravel en los Estados Unidos, donde había un claro reconocimiento de que este enfoque no será suficiente y la única manera de destacar es a través de la innovación digital y datos.

El desafío

Es evidente que hay un desafío para las empresas turísticas que se dependen de la diferenciación de su producto para seguir siendo competitivos. Entonces la gran pregunta es: ¿cómo los proveedores pueden crear una diferenciación significativa en sus productos para fidelizar a los clientes y al mismo tiempo, seguir siendo competitivos en precio? La respuesta a este desafío radica en el uso efectivo y un gran análisis de datos.

“La única manera de superar la mercantilización en el mercado de viajes es a través de la personalización y un uso más inteligente de los datos. Las marcas necesitan entender quiénes son sus clientes, para donde están viajando, cuándo y por qué. Con estos datos pueden encontrar lo que necesitan hacer para destacarse de la competencia “. (Carlos Sánchez, gerente senior de análisis de datos y productos innovadores de negocio de agencia de viajes Carlson Wagonlit Travel)

La solución

Una manera de hacer un producto estandarizado parecer diferente es envolviendolo en un experimento que lo diferencia. Por ejemplo, mientras que cada billete es esencialmente el mismo si usted está mirando solo para la parte aérea básica, se puede diferenciar si las aerolíneas pueden mejorar la experiencia de viaje de extremo a extremo con la adición de los servicios auxiliares. Estos servicios pueden incluir una mejor funcionalidad de la aplicación, que ofrece una reserva sencilla, check-in rápido y fácil acceso a los servicios adicionales, tales como los viajes al aeropuerto y otros.

Del mismo modo, hoteles comoditizados pueden mejorar su experiencia con beneficios adicionales, tales como check-in anticipado, aplicación que funciona como llave de la habitación, servicios de conserjería digitales, reconocimiento del cliente, las tasas individualizadas etc.

De este modo, mientras que el producto básico se indiferenciado, el cliente percibe la experiencia en general como positivamente memorable. “Todo está orientado para hacer el viaje la mejor experiencia que pueda ser, una experiencia que se permanece en su mente para que escoja el mismo proveedor la próxima vez que viaje”, dice Sánchez.

Lo que hace esto mucho más fácil hoy en día es el creciente uso de dispositivos móviles por los viajeros, la disponibilidad de grandes cantidades de datos en la base de clientes y algoritmos de inteligencia artificial precisos, que ayudan a identificar las maneras de hacer que los viajes de negocios sean más fáciles y memorables.

Y en la práctica?

Por ejemplo, Pmweb ofrece una completa infraestructura de servicios de datos y tecnologías orientadas a la industria de la hospitalidad. Cada día, las integraciones con los principales PMS del mercado, recibiendo grandes cantidades de datos de huéspedes, realizamos la recogida y tratamiento de los datos procedentes de web behavior en el sitio web del cliente.

Estos datos, integrados con Pmweb CRM, pueden ser utilizados en las campañas online para pre-check in, post-check out, reservas abandonadas, reviews, ventas cruzadas y otros. Además, los datos pueden apoyar la estrategia de precios individuales de las tarifas a través del Let’s Book, el motor de reservas que utiliza estos datos, teniendo en cuenta factores tales como la frecuencia, ticket promedio, perfil geográfico y demográfico, las interacciones con los emails y otros.

Sin embargo, cualesquiera que sean las herramientas elegidas, plataformas de inteligencia de negocios se pueden basar en cuatro características clave:

- Modelo de datos centrado en el usuario y basado en eventos

- Plataforma cruzada – que cubre la aplicación nativa, el sitio móvil y el sitio web

- Recolección de datos en tiempo real, manipulación y exportación de datos en bruto a cualquier escala

- Datos accesibles a través de herramientas simples y fáciles de usar, que permiten a las personas obtener respuestas a las preguntas.

Fuente: eye for travel[:]

A Plataforma de Experimentação da Netflix

[:pt]Já se perguntou como a Netflix serve uma excelente experiência de streaming de vídeo, com alta qualidade e o mínimo de interrupções na reprodução? Graças à equipe de engenheiros e cientistas de dados que aplicam testes A/B constantemente suas inovações para os nossos algoritmos de entrega de conteúdo e transmissão personalizada. E quanto a mudanças mais óbvias, como a reformulação completa do nosso layout da interface de usuário ou a nossa nova página inicial personalizada? Sim, tudo resultado de testes A/B.

Cada mudança de produto que a Netflix considera passa por um processo rigoroso de testes A/B antes de se tornar a experiência padrão do usuário. Grandes alteraçoes no design, como os acima, melhoram muito o serviço ao permitir que membros encontrem mais rápido o conteúdo que eles querem assistir. No entanto, é muito arriscado publicar este tipo de redesign sem extensos testes A/B, que permitem provar que a nova experiência é teve mais sucesso do que a anterior. E se você já se perguntou se a intenção é realmente de testar tudo o que der, saiba que até as imagens associadas com muitos títulos passaram por testes A/B, às vezes resultando em 20% a 30% a mais de visualização para esse título!

Resultados como esses demonstram por que somos fãs de carteirinha de testes A/B. Ao seguir uma abordagem empírica, garantimos que as alterações do produto não são guiadas por achismos dos funcionários da Netflix, mas por dados reais, permitindo que os nossos próprios clientes nos guiem em direção as experiências que amam.

Neste post vamos falar sobre a Plataforma de Experimentação: o serviço que torna possível para cada equipe de engenharia da Netflix implementar os seus testes A/B com o apoio de uma equipe de engenharia especializada. Vamos começar definindo um contexto de alto nível em torno de testes A/B antes de falar da arquitetura de nossa plataforma atual e como outros serviços interagem com a plataforma para trazer um teste A/B à vida.

Visão geral

O conceito geral por trás dos testes A/B é criar uma experiência com um grupo controle e um ou mais grupos experimentais (chamados de “células” dentro da Netflix) que recebem tratamentos alternativos. Cada membro pertence exclusivamente a uma célula dentro de um dado experimento e uma das células é sempre designada a “célula padrão”. Esta célula representa o grupo de controle, que recebe a mesma experiência que todos os membros da Netflix fora do teste. Assim que o teste começa a rodar, nós acompanhamos as métricas específicas de importância, geralmente (mas nem sempre) número de horas de streaming e de retenção. Uma vez que temos número suficiente de participantes para tirar conclusões estatisticamente significativas, podemos obter uma leitura sobre a eficácia de cada célula de teste e encontrar um vencedor.

Do ponto de vista do participante, cada membro é geralmente parte de vários testes A/B, em determinado momento, desde que os testes não entrem em conflito um com o outro (dois testes que modificam a mesma área de um Netflix App de diferentes maneiras) . Para ajudar os proprietários dos testes a rastrear conflitantos em potencial, nós fornecemos um test schedule view no ABlaze, o front-end da nossa plataforma. Esta ferramenta permite filtrar testes em diferentes dimensões para encontrar outros testes que podem impactar uma área semelhante a sua.

Há mais um tópico para resolver antes de nos aprofundarmos em detalhes: como os participantes são alocados a um determinado teste. Apoiamos duas formas primárias de alocação: lote e em tempo real.

Alocações de lote dão aos analistas a máxima flexibilidade, permitindo-lhes preencher testes usando tanto consultas personalizadas simples como complexas, conforme for necessário. Estas consultas retornam um conjunto fixo e conhecido de membros que são então adicionados ao teste. As principais desvantagens desta abordagem é que ela não tem a capacidade de alocar novos clientes e não consegue alocar com base no comportamento do usuário em tempo real. E enquanto o número de membros alocado é conhecido, não se pode garantir que todos os membros alocados vão passar pelo teste (por exemplo, se estamos testando um novo recurso em um iPhone, não podemos ter certeza de que cada participante alocado irá acessar a Netflix em um iPhone enquanto o teste estiver ativo).

Alocações em tempo real fornecem aos analistas a capacidade de configurar regras que são avaliadas conforme o usuário interage com a Netflix. Usuários elegíveis são alocados para o teste em tempo real, contanto que atendam aos critérios especificados nas normas e não estejam atualmente em um teste conflitante. Como resultado, esta abordagem supera as fraquezas inerentes à abordagem de lote. A principal desvantagem para a alocação em tempo real, no entanto, é que a aplicação incorre latências adicionais à espera de resultados de alocação. Felizmente, muitas vezes pode executar esta chamada em paralelo enquanto o aplicativo está aguardando outras informações. A questão secundária com a alocação em tempo real é a dificuldade em estimar quanto tempo levará para que o número desejado de membros seja atribuído a um teste, a fim de determinar quando eles podem avaliar os resultados.

O típico fluxo de trabalho de um teste A/B

Com esse background, já podemos mergulhar mais a fundo. O fluxo de trabalho típico envolvido na Plataforma de Experimentação (referida como A/B nos diagramas) é melhor explicado usando o seguinte fluxo de trabalho para um teste de seleção de imagens. Note-se que há nuances para o diagrama abaixo, que não serão abordadas em profundidade, em particular a arquitetura da camada API da Netflix, que atua como um gateway entre aplicativos Netflix externos e serviços internos.

Neste exemplo, nós estamos executando um teste A/B hipotético com a finalidade de encontrar a imagem que resulta em um maior número de membros assistindo a um título específico. Cada célula representa uma imagem. No diagrama também estamos assumindo um fluxo de chamadas a partir de um Netflix App sendo executado em um PS4, embora o mesmo fluxo é válido para a maioria dos nossos Device Apps.

1. O Netflix PS4 App chama a API Netflix. Como parte dessa chamada, ele oferece uma carga JSON contendo informações sobre o nível da sessão relacionadas ao usuário e seu dispositivo.

2. A chamada é processada em um script escrito pela equipe de PS4 App. Esse script é executado na Client Adaptor Layer da API Netflix, onde cada equipe de Client App acrescenta scripts relevantes para o seu app. Cada um desses scripts vêm completos com seus próprios terminais REST distintos. Isso permite que a API da Netflix possua funcionalidades comuns à maioria dos aplicativos, dando a cada app controle sobre a sua lógica específica. O PS4 App Script agora chama o A/B Client, uma biblioteca nossa equipe mantém dentro da API Netflix. Esta biblioteca permite a comunicação com nossos servidores back-end, bem como outros serviços internos da Netflix.

3. O A/B Client chama um conjunto de outros serviços para reunir contexto adicional sobre o membro e o dispositivo.

4. O A/B Client então chama o A/B Server para avaliação, passando por todo o contexto de que dispõe.

5. Na fase de avaliação:

a. O A/B Server recupera todas as combinações de teste/célula à qual este membro já está alocado.

b. Para os testes que utilizam a abordagem de alocação de lotes, as alocações já são conhecidas nesta fase.

c. Para os testes que utilizam a alocação em tempo real, o A/B Server avalia o contexto para ver se o membro deve ser alocado para quaisquer testes adicionais.

d. Uma vez que todas as avaliações e atribuições são concluídas, o A/B Server passa o conjunto completo de testes e células para o cliente A/B, que por sua vez passa para o PS4 App Script. Note que o PS4 App não tem idéia se o usuário está em um determinado teste por semanas ou só nos últimos microssegundos. Ele não precisa saber ou se preocupa com isso.

6. Dadas as combinações de teste/célula devolvidas a ele, o PS4 App Script agora atua em todos os testes aplicáveis à solicitação do cliente atual. No nosso exemplo, ele vai usar essas informações para selecionar a peça adequada de arte associada com o título ele precisa exibir, que é devolvido pelo serviço que detém esses metadados de título. Note-se que a Plataforma de Experimentação na verdade não controla este comportamento: isso é tarefa do serviço que realmente implementa cada experiência dentro de um determinado teste.

7. O PS4 App Script (através da API Netflix) “conta” à PS4 App qual imagem será exibida, juntamente com todas as outras operações que o PS4 App deve realizar, a fim de processar corretamente a interface do usuário.

Agora que entendemos o fluxo de chamadas, vamos dar uma olhada naquela rotulada “A/B Server”.

A Plataforma de Experimentação

Os pedidos de atribuição e recuperação descritos na seção anterior passam por terminais de API REST para o nosso servidor. Metadados de teste referentes a cada teste, incluindo regras de alocação, são armazenados em um armazenamento de dados Cassandra. São essas regras de alocação que são comparadas com o contexto passado do A/B Client, a fim de determinar a elegibilidade de um membro para participar de um teste (por exemplo, um usuário na Austrália, em um PS4, que nunca tinha usado esta versão do app PS4).

Alocações membros também são persistentes em Cassandra, liderada por uma camada de cache na forma de um cluster EVCache, que serve para reduzir o número de chamadas diretas para Cassandra. Quando um aplicativo faz uma solicitação para alocações atuais, o A/B Client verifica primeiro o EVCache para registros de alocação referentes a este membro. Se esta informação foi previamente solicitada dentro das últimas 3 horas (o TTL para o nosso cache), uma cópia das alocações será devolvida a partir do EVCache. Se não, o A/B Server faz uma chamada direta para Cassandra, passando as atribuições de volta para o A/B Client e, simultaneamente, preenchendo-as em EVCache.

Quando ocorrem alocações para um teste A/B, temos de decidir em que célula colocar cada membro. Esta etapa deve ser trabalhada com cuidado, uma vez que a população em cada célula deve ser o mais homogênea possível, a fim de tirar conclusões estatisticamente significativas a partir do teste. A homogeneidade é medida em relação a um conjunto de dimensões fundamentais, dais que país e tipo de dispositivo (isto é, SmartTV, console de jogos, etc.) são os mais proeminentes. Consequentemente, o nosso objetivo é assegurar que cada célula contenha proporções semelhantes de membros de cada país, utilizando proporções semelhantes de cada tipo de dispositivo, etc. Uma amostragem puramente aleatória pode prejudicar os resultados do teste caso, por exemplo, aloque mais australianos usuários do console em uma célula em relação a outra. Para mitigar esse problema que empregam um método de amostragem chamado amostragem estratificada, que visa manter a homogeneidade entre os principais dimensões acima mencionadas. Há uma boa quantidade de complexidade para a nossa implementação de amostragem estratificada, que pretendemos compartilhar em um futuro post.

Na etapa final do processo de atribuição, nós persistimos detalhes de alocação em Cassandra e invalidamos os caches A/B associados a este membro. Como resultado, na próxima vez que receber um pedido de alocação referente a este membro, vamos experimentar uma perda de cache e executar os passos relacionados a cache descritos acima.

Também publicamos simultaneamente eventos de alocação a um pipeline de dados Kafka, que alimenta em vários armazenamentos de dados. O fed publicado em tabelas Hive fornece uma fonte de dados para análise ad-hoc, bem como Ignite, a ferramnta interna da Netflix para visualização e análise de testes A/B. É dentro do Ignite que os proprietários de teste analisam métricas de interesse e avaliar os resultados de um teste. Este assunto vai render outro post, focado em Ignite, no futuro próximo.

As atualizações mais recentes para na nossa tecnologia faísca acrescentaram o Spark Streaming, que ingere e transforma dados de Kafka streams antes de persisti-los em ElasticSearch, o que nos permite exibir perto de atualizações em tempo real no ABlaze. Nossos atuais casos de uso envolvem métricas simples, permitindo aos utilizadores visualizar as alocações de teste em tempo real através das dimensões de interesse. No entanto, estas adições têm lançado os alicerces para análises em tempo real muito mais sofisticadas no futuro próximo.

Projetos futuros

A arquitetura que descrevemos aqui tem funcionado bem para nós até agora. Continuamos a dar suporte a um conjunto cada vez maior de domínios: UI, recomendações, playback, busca, e-mail, assinatura e muitos mais. Através de auto-scaling, lidamos tranquilamente com o tráfego normal da nossa plataforma, que varia de 150K a 450K pedidos por segundo. Do ponto de vista responsivo, latências que buscam a alocações existentes variam de uma média de 8 ms quando o nosso cache é frio para <1ms quando o cache é quente. avaliações em tempo real demorar um pouco mais, com uma latência média de cerca de 50ms.

No entanto, como nossa base de membros continua a se expandir globalmente, a velocidade e a variedade de testes A/B está crescendo rapidamente. Só para contextualizar, a arquitetura geral que acabamos de descrever já era usada desde 2010 (com algumas exceções óbvias, como Kafka). Desde então:

– A Netflix cresceu de streaming em 2 países para mais de 190

– Passamos de 10 milhões de membros para mais de 80 milhões

– Fomos de dezenas de dispositivos a milhares, muitos deles com seu próprio app Netflix

A expansão internacional é parte da razão pela qual estamos vendo um aumento nos tipos de dispositivos. Em particular, há um aumento no número de dispositivos móveis usados para transmitir Netflix. Nesta arena, contamos com alocações de lote, como a nossa atual abordagem de alocação em tempo real simplesmente não funciona: a largura de banda em dispositivos móveis não é confiável o suficiente para uma aplicação esperar por nós antes de decidir qual experiência servir … tudo isso enquanto o usuário está impaciente olhando para uma tela de carregamento.

Além disso, algumas novas áreas de inovação conduzem testes A/B em um tempo muito mais curto do que antes. Testes focados em mudanças de interface do usuário, algoritmos de recomendação, etc. muitas vezes correm por semanas antes que seus efeitos sobre o comportamento do usuário possam ser medidos com clareza. No entanto, os testes de streaming adaptativo mencionados no início deste post são realizadas em uma questão de horas.

Como resultado, existem vários aspectos da nossa arquitetura que estamos planejando reformular significativamente. Por exemplo, enquanto o mecanismo de atribuição em tempo real permite o controle granular, as avaliações precisam ser mais rápidas e devem interagir mais eficientemente com dispositivos móveis.

Nós também planejamos alavancar os dados que fluem através do Spark Streaming para começar a prever taxas de alocação por teste, dadas as regras de alocação. O objetivo é resolver a segunda principal desvantagem da abordagem de atribuição em tempo real, que é a incapacidade de prever a quantidade de tempo necessária para obter membros suficientes alocados no teste. Dando analistas a capacidade de prever as taxas de alocação vai permitir um planejamento e coordenação de testes mais precisos.

Estes são apenas alguns dos nossos próximos desafios. Se você está simplesmente curioso para saber mais sobre como lidamos com eles, fique atento para os próximos posts. No entanto, se a idéia de resolver estes desafios e nos ajudar a construir a próxima geração de plataforma de experimentação da Netflix te excita, sinta-se livre para falar conosco!

Texto original, por Steve Urban, Rangarajan Sreenivasan e Vineet Kannan.

Adaptação e tradução: Maria Sebastiany

[:en]Ever wonder how Netflix serves a great streaming experience with high-quality video and minimal playback interruptions? Thank the team of engineers and data scientists who constantly A/B test their innovations to our adaptive streaming and content delivery network algorithms. What about more obvious changes, such as the complete redesign of our UI layout or our new personalized homepage? Yes, all thoroughly A/B tested.

In fact, every product change Netflix considers goes through a rigorous A/B testing process before becoming the default user experience. Major redesigns like the ones above greatly improve our service by allowing members to find the content they want to watch faster. However, they are too risky to roll out without extensive A/B testing, which enables us to prove that the new experience is preferred over the old. And if you ever wonder whether we really set out to test everything possible, consider that even the images associated with many titles are A/B tested, sometimes resulting in 20% to 30% more viewing for that title!

Results like these highlight why we are so obsessed with A/B testing. By following an empirical approach, we ensure that product changes are not driven by the most opinionated and vocal Netflix employees, but instead by actual data, allowing our members themselves to guide us toward the experiences they love.

In this post we’re going to discuss the Experimentation Platform: the service which makes it possible for every Netflix engineering team to implement their A/B tests with the support of a specialized engineering team. We’ll start by setting some high level context around A/B testing before covering the architecture of our current platform and how other services interact with it to bring an A/B test to life.

Overview

The general concept behind A/B testing is to create an experiment with a control group and one or more experimental groups (called “cells” within Netflix) which receive alternative treatments. Each member belongs exclusively to one cell within a given experiment, with one of the cells always designated the “default cell”. This cell represents the control group, which receives the same experience as all Netflix members not in the test. As soon as the test is live, we track specific metrics of importance, typically (but not always) streaming hours and retention. Once we have enough participants to draw statistically meaningful conclusions, we can get a read on the efficacy of each test cell and hopefully find a winner.

From the participant’s point of view, each member is usually part of several A/B tests at any given time, provided that none of those tests conflict with one another (i.e. two tests which modify the same area of a Netflix App in different ways). To help test owners track down potentially conflicting tests, we provide them with a test schedule view in ABlaze, the front end to our platform. This tool lets them filter tests across different dimensions to find other tests which may impact an area similar to their own.

There is one more topic to address before we dive further into details, and that is how members get allocated to a given test. We support two primary forms of allocation: batch and real-time.

Batch allocations give analysts the ultimate flexibility, allowing them to populate tests using custom queries as simple or complex as required. These queries resolve to a fixed and known set of members which are then added to the test. The main cons of this approach are that it lacks the ability to allocate brand new customers and cannot allocate based on real-time user behavior. And while the number of members allocated is known, one cannot guarantee that all allocated members will experience the test (e.g. if we’re testing a new feature on an iPhone, we cannot be certain that each allocated member will access Netflix on an iPhone while the test is active).

Real-Time allocations provide analysts with the ability to configure rules which are evaluated as the user interacts with Netflix. Eligible users are allocated to the test in real-time if they meet the criteria specified in the rules and are not currently in a conflicting test. As a result, this approach tackles the weaknesses inherent with the batch approach. The primary downside to real-time allocation, however, is that the calling app incurs additional latencies waiting for allocation results. Fortunately we can often run this call in parallel while the app is waiting on other information. A secondary issue with real-time allocation is that it is difficult to estimate how long it will take for the desired number of members to get allocated to a test, information which analysts need in order to determine how soon they can evaluate the results of a test.

A Typical A/B Test Workflow

With that background, we’re ready to dive deeper. The typical workflow involved in calling the Experimentation Platform (referred to as A/B in the diagrams for shorthand) is best explained using the following workflow for an Image Selection test. Note that there are nuances to the diagram below which I do not address in depth, in particular the architecture of the Netflix API layer which acts as a gateway between external Netflix apps and internal services.

In this example, we’re running a hypothetical A/B test with the purpose of finding the image which results in the greatest number of members watching a specific title. Each cell represents a candidate image. In the diagram we’re also assuming a call flow from a Netflix App running on a PS4, although the same flow is valid for most of our Device Apps.

- The Netflix PS4 App calls the Netflix API. As part of this call, it delivers a JSON payload containing session level information related to the user and their device.